Olasılık ağacı

İçinde temel olasılık , bir olasılık ağaç bilerek rastgele deney özetlemek için izin veren bir diyagramdır şartlı olasılık .

Bu ağaçlar karar teorisinde yaygın olarak kullanılmaktadır .

Gerçek bir problem örneği

Petrol sondajı örneği . İzin verin p bilinen bir olasılıkla petrolün varlığını hesapladığımız bir yer olsun .

Bir test yaparsak, bu olasılık hala bilinmeyen bir q değerine düzeltilebilir . Test pahalıdır ancak kuru bir kuyuyu açmayı önleyebilir. Öte yandan, testin başarısı, kuyunun kuru olmayacağı kesin olarak anlamına gelmez.

Testi yapmalı mıyız? Testi yapmadan sondaj yapmalı mıyız?

Deneysel plana bakın , Tek kollu haydut (matematik) .

Başka bir örnek

Aşağıdaki rastgele deneyi özetlemeye çalışıyoruz:

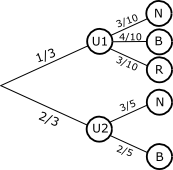

Bir zar atıyoruz- Elde edilen sayı 3'ün katı ise, 3 siyah top, 4 beyaz top ve 3 kırmızı top içeren 1. torbadan rastgele bir top çıkarırız

- Elde edilen sayı 3'ün katı değilse, 3 siyah top ve 2 beyaz top içeren 2. torbadan bir top çıkarılır.

İlk adım, bir evren tanımlamayı mümkün kılar Ω = {1; 2; 3; 4; 5; 6} bir eşlenebilirlik uyguladığımız (kalıbın mükemmel dengelenmiş olduğunu tahmin ediyoruz). Daha sonra iki tamamlayıcı olayı ele alıyoruz

- U 1 = "fırlatma, 1 numaralı torbada atışa yol açar"

- U 2 = "fırlatma, 2 numaralı torbaya atışla sonuçlanır"

Bu nedenle U 1 = {3; 6} ve p ( U 1 ) = 1/3 sonra p ( U 2 ) = 2/3 .

İkinci adımı incelemek için, 1. torbada veya 2. torbada çekim yaptığınızda ne olduğunu incelemelisiniz.

- Torba 1'deki çizim bir evren tanımlamayı mümkün kılar Ω 1 = { N ; B ; Aşağıdaki olasılığı uyguladığımız

R }

- p ( N ) = 3/10

- p ( B ) = 4/10

- p ( R ) = 3/10 .

- Aynı şekilde, 2 numaralı sandıkta çizim yapmak , 3/5 ve 2/5 olasılıkların Ω 2 = { N , B } evrenini tanımlamayı mümkün kılar .

Deneyim daha sonra aşağıdaki ağaçta özetlenir:

Olasılıkları okumak daha sonra kolayca yapılır:

- 1. torbada atış yapma ve çeyrek not alma olasılığı:

- 2. torbada atış yapma ve çeyrek not alma olasılığı:

Siyah bir topa vurma olasılığı şu şekildedir:

Çözülmüş egzersiz

Gerard, A veya B olmak üzere iki yoldan işe koyulabilir. A yolunu izleme olasılığı 0,4'tür. A yoluna girerse, geç kalma olasılığı 0.2'dir. B yoluna girerse, geç kalma olasılığı 0.6'dır. Ya R Etkinliği "Gerard geç kaldı" ve R c , R'nin tamamlayıcısıdır .Olasılıkları çıkarıyoruz

"A yolunu izleme olasılığı 0,4'tür." : P ( A ) = 0,4 . Yalnızca iki olası yol olduğundan, P ( B ) = 1 - P ( A ) = 0.6'dır . "A yolunu seçerse, geç kalma olasılığı 0.2'dir." : P A ( R ), 0.2 = . A yolunu aldığını bilmenin geç kalmama olasılığı bu nedenle tamamlayıcı P A ( R c ) = 1 - P A ( R ) = 0.8'dir . "B yoluna girerse, geç kalma olasılığı 0,6'dır." : P B ( R ) = 0.6 Aynı şekilde, P B ( R c ) = 1 - P B ( R ) = 0.4 .Tanımlar ve özellikler

Bir olasılık ağacına aşağıdaki kurallara uyan yönlendirilmiş ve ağırlıklı bir grafik diyoruz

- Aynı köşeden kaynaklanan dalların ağırlıklarının (veya olasılıklarının) toplamı 1 verir.

- Bir yolun olasılığı, onu oluşturan dalların olasılıklarının ürünüdür.

- A tepe noktasından B tepe noktasına giden dalın ağırlığı, A'nın halihazırda p A ( B ) gerçekleştirildiğini bilen B'nin koşullu olasılığıdır .

Ardından koşullu olasılığın özelliğini buluruz :

(yolların ürünü).Toplam olasılık formülünün yanı sıra :

Eğer Q 1 , Q 2 , ..., Ω n tanımlar bir bölümü Q (iki-iki ayrık setleri olan birlik verir Q'dan ), eğer Q i , sıfır olmayan olasılık ve A bir olay olup olmadığını Ω,Örnekte p ( N ) ' yi hesaplamak için kullandık

Olasılık ağacı ayrıca koşullu olasılıkların veya Bayes teoreminin tersine çevrilmesini kolaylaştırır :

Bir önceki örnekte, bu şu soruyu sormak anlamına gelir: "Bir çeyrek nota attığımızı bildiğimiz halde, 1. sandıkta ateş etme olasılığımız nedir?" "